Spine-Leaf-Architektur Was ist eine Spine-Leaf-Architektur?

Eine Spine-Leaf-Architektur ist eine Netzwerktopologie für Rechenzentren, die aus zwei Switching-Ebenen besteht – einer Spine- und einer Leaf-Ebene. Die Leaf-Ebene besteht aus Access-Switches, die den Datenverkehr von Servern aggregieren und eine direkte Verbindung zum Spine- oder Netzwerkkern herstellen. Spine-Switches verbinden alle Leaf-Switches in einer Full-Mesh-Topologie.

Inhaltsverzeichnis

Lesezeit: 3 Minuten 45 Sekunden | Veröffentlicht: 27. März 2026

Aus welchen Komponenten besteht eine Spine-Leaf-Architektur?

Die Spine-Leaf-Architektur besteht aus zwei Hauptebenen: der Spine-Ebene und der Leaf-Ebene. Leaf-Switches bündeln den Datenverkehr von Servern und Speichern und stellen die Verbindung direkt zum Netzwerkkern her. Spine-Switches hingegen fungieren als Hochgeschwindigkeits-Backbone und verbinden alle Leaf-Switches in einer vollständig vermaschten Topologie, um eine beliebige Konnektivität mit minimaler Latenz zu gewährleisten.

Wie unterscheidet sich eine Spine-Leaf-Architektur von herkömmlichen Netzwerkdesigns?

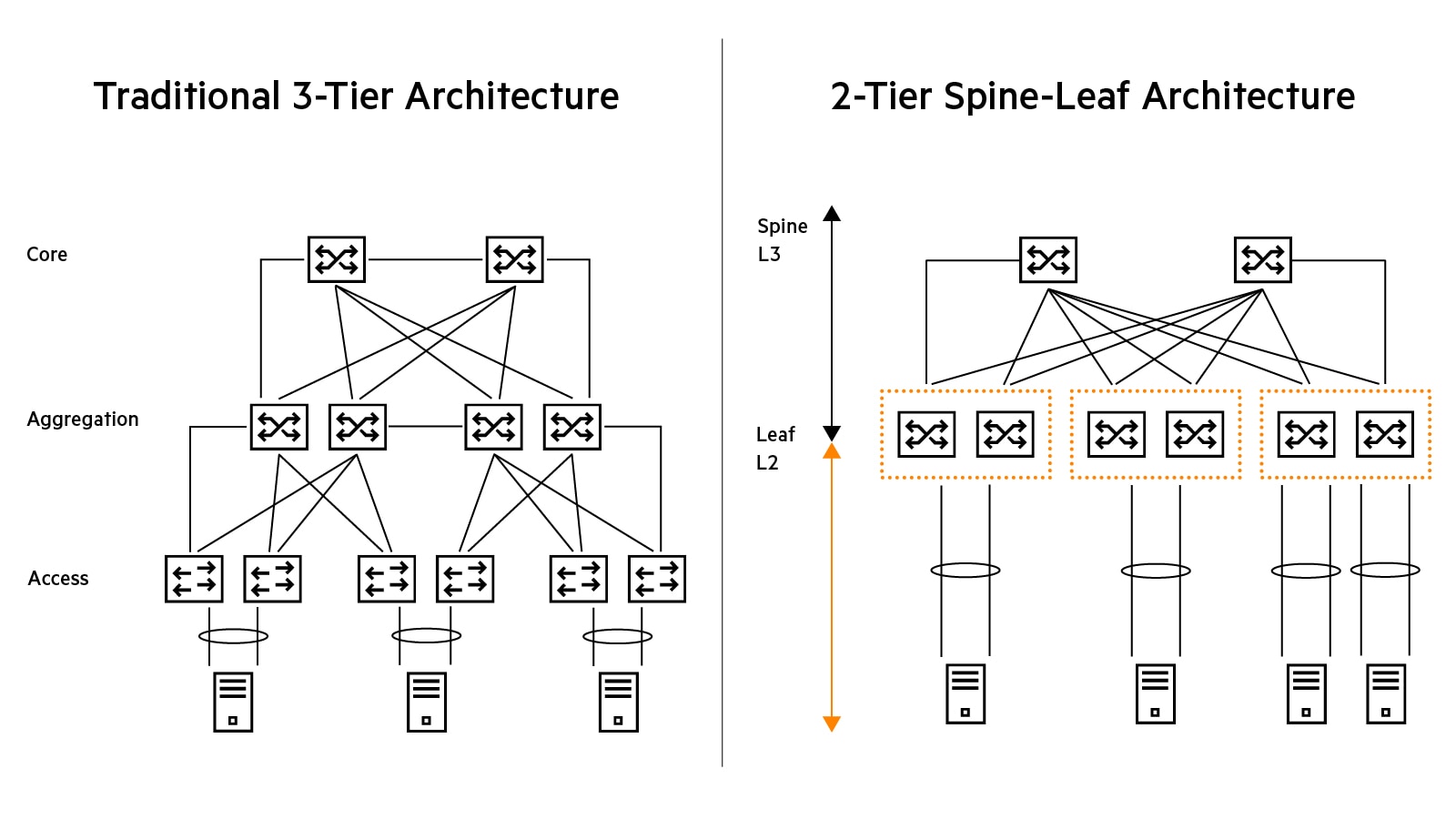

Herkömmliche Rechenzentrumsnetze basierten auf einem dreistufigen Modell:

- Access-Switches stellen eine Verbindung zu Servern her.

- Aggregation- oder Distribution-Switches bieten redundante Verbindungen zu Access-Switches.

- Core-Switches ermöglichen den schnellen Transport zwischen Aggregation-Switches, die in der Regel in einem redundanten Paar verbunden sind, um eine hohe Verfügbarkeit zu gewährleisten.

Auf der grundlegendsten Ebene verbindet eine Spine-Leaf-Architektur eine dieser Tiers, wie in diesen Diagrammen dargestellt.

Weitere häufige Unterschiede bei Spine-Leaf-Topologien sind:

- Das Entfernen des Spanning Tree Protocol (STP).

- Verstärkter Einsatz von Switches mit festen Ports gegenüber modularen Modellen für das Netzwerk-Backbone.

- Aufgrund der höheren Anzahl an Verbindungen müssen mehr Kabel gekauft und gewartet werden.

- Scale-Out im Vergleich zu Scale-Up der Infrastruktur.

Warum werden Spine-Leaf-Architekturen immer beliebter?

Angesichts der Verbreitung von Cloud- und Container-Infrastrukturen in modernen Rechenzentren nimmt der Ost-West-Verkehr weiter zu. Der Ost-West-Verkehr bewegt sich seitlich von Server zu Server. Dieser Wandel lässt sich vor allem dadurch erklären, dass moderne Anwendungen über Komponenten verfügen, die auf mehrere Server oder virtuelle Maschinen verteilt sind.

Beim Ost-West-Verkehr sind optimierte Verkehrsflüsse mit geringer Latenz für die Leistung zwingend erforderlich, insbesondere bei zeitkritischen oder datenintensiven Anwendungen. Eine Spine-Leaf-Architektur unterstützt dies, indem sie sicherstellt, dass der Datenverkehr immer die gleiche Anzahl von Hops von seinem nächsten Ziel entfernt ist, sodass die Latenz geringer und vorhersehbarer ist.

Auch die Kapazität verbessert sich, da kein STP mehr erforderlich ist. STP ermöglicht redundante Pfade zwischen zwei Switches, es kann allerdings immer nur einer aktiv sein. Dies hat zur Folge, dass bestimmte Pfade häufig überlastet sind. Im Gegensatz dazu basieren Spine-Leaf-Architekturen auf Protokollen wie Equal-Cost Multipath (ECMP)-Routing, um den Datenverkehr über alle verfügbaren Pfade auszugleichen und gleichzeitig Netzwerkschleifen zu verhindern.

Spine-Leaf-Topologien bieten neben einer höheren Leistung auch eine bessere Skalierbarkeit. Um die Kapazität zu erhöhen, können zusätzliche Spine-Switches hinzugefügt und an jedes Leaf angeschlossen werden. Ebenso können neue Leaf-Switches nahtlos eingefügt werden, wenn die Portdichte zum Problem wird. In beiden Fällen ist für dieses „Scale-Out“ der Infrastruktur keine Neustrukturierung des Netzwerks erforderlich und es kommt zu keinen Ausfallzeiten.

Was sind die Vorteile einer Spine–Leaf-Architektur?

Die Spine-Leaf-Architektur bietet im Vergleich zu älteren 3-stufigen-Designs eine überlegene Skalierbarkeit und geringere Latenz. Durch die Aufrechterhaltung aller Netzwerkpfade via ECMP wird eine enorme Bandbreite für den Server-zu-Server-Verkehr bereitgestellt. Im Gegensatz zu herkömmlichen Modellen, die für ein Wachstum komplexe Umstrukturierungen erfordern, ermöglicht dieses Design eine „Scale-out“-Erweiterung, bei der durch das Hinzufügen von Switches die Kapazität erhöht wird, ohne dass es zu Netzwerkausfallzeiten kommt.

Aufbau einer Spine-Leaf-Architektur mit HPE Aruba Networking CX Switching

Das HPE Aruba Networking CX Switching Portfolio ist für die sich entwickelnden, komplexen Anforderungen moderner Rechenzentrumsumgebungen, einschließlich Spine-Leaf-Fabrics, konzipiert. HPE Aruba Networking CX Switches basieren auf einer verteilten, nicht blockierenden Architektur, die echte kabelgebundene Geschwindigkeitsleistung von 1 GbE bis 100 GbE bietet.

Zu den HPE Aruba Networking CX Switches für Spine-Leaf-Fabrics gehören:

- HPE Aruba Networking CX 6400: Ein modularer 5- oder 10-Slot-Switch mit einer Kapazität von bis zu 28 Tbit/s

- HPE Aruba Networking CX 8325: Ein 1U-Switch mit 1/10/25/40/100 GbE Konnektivität, ideal für Leaf- oder Spine-Switches

- HPE Aruba Networking CX 8320: Ein 1U-Leaf-Switch mit 10 GbE Serverkonnektivität und 40 GbE zum Spine

- HPE Aruba Networking CX 8400: Ein modularer Switch mit einer Kapazität bis zu 19,2 Tbit/s, ideal für Spine- und Leaf-Switches, bei denen eine höhere Portdichte erforderlich ist

Alle HPE Aruba Networking CX Switches basieren auf AOS-CX, einem Cloud-nativen Betriebssystem, das die Verwaltung von Rechenzentrumsnetzen mit leistungsstarker Automatisierung, Analyse und Support für Live-Upgrades vereinfacht.

Häufige Fragen zur Spine-Leaf-Architektur

Wie funktioniert die Spine-Leaf-Architektur?

Spine-Leaf ist eine flache, zweistufige Topologie, die für leistungsstarke Ost-West-Datenübertragung entwickelt wurde. Jeder Leaf-Switch ist mit jedem Spine-Switch verbunden, wodurch sichergestellt wird, dass Daten immer genau zwei „Hops“ durchlaufen. Durch den Ersatz des restriktiven Spanning Tree Protocol (STP) durch Layer-3-Routing und ECMP, nutzt es alle verfügbaren Pfade gleichzeitig, um die in 3-stufigen Modellen häufig auftretenden Engpässe zu vermeiden.

Welche Anwendungsfälle gibt es für die Spine-Leaf-Architektur?

Spine-Leaf-Architektur ist der Standard für moderne Rechenzentren, die hohe Mengen an lateralem Verkehr bewältigen. Zu den wichtigsten Anwendungsfällen gehören Cloud Computing, containerisierte Microservices und KI/ML-Workloads. Sie ist außerdem für Big Data-Analysen und den Hochfrequenzhandel unerlässlich, bei denen vorhersehbare Leistung und Hochgeschwindigkeits-Datenübertragung zwischen verteilten Knoten geschäftskritisch sind.

Welche Herausforderungen bringt die Implementierung einer Spine-Leaf-Architektur mit sich?

Die größten Herausforderungen bestehen in der zunehmenden Komplexität der Verkabelung und dem Bedarf an fortschrittlichem Fachwissen im Routing. Da jedes Leaf mit jedem Spine verbunden sein muss, ist das physische Kabelmanagement aufwändiger als bei dreistufigen Modellen. Zusätzlich erfordern die benötigten Layer-3-Protokolle und -Overlays für eine nicht blockierende Fabric ausgefeiltere Managementtools und eine sorgfältigere Planung.

Worin besteht der Unterschied zwischen der Spine-Leaf-Architektur und der Clos-Architektur?

Spine-Leaf ist eine moderne, zweistufige Anwendung der Clos-Architektur, eine mehrstufige Netzwerktopologie, die für blockierungsfreie Leistung ausgelegt ist. Während die Clos-Architektur den theoretischen Rahmen bildet, der sicherstellt, dass jede Eingabe ohne Störungen mit jeder Ausgabe verbunden werden kann, ist Spine-Leaf die spezifische Implementierung, die traditionelle Hierarchien in Rechenzentren mit hoher Dichte ersetzt.

Wie verbessert die Spine-Leaf-Architektur die Skalierbarkeit von Rechenzentren?

Die Spine-Leaf-Architektur ermöglicht eine „horizontale“ Skalierung. Wenn Sie mehr Serveranschlüsse benötigen, fügen Sie einen Leaf-Switch hinzu. Benötigen Sie mehr Bandbreite zwischen den Switches, ergänzen Sie einen Spine-Switch. Dieser „Pay-as-you-grow“-Ansatz ermöglicht eine Erweiterung, ohne die vorhandene Hardware auszutauschen oder die logische Struktur des Netzwerks zu verändern, und ist somit deutlich flexibler als herkömmliche „vertikale“ Skalierungsmodelle.